借助英偉達全新CMX平臺突破GPU內存墻瓶頸

在擴展 AI 工作負載的過程中,你會遇到的問題之一就是 KV 緩存耗盡 HBM 內存,這會限制 AI 應用的 “記憶” 容量,并導致用戶體驗下降。針對這一問題,英偉達及其合作伙伴正在開發全新的 上下文內存存儲平臺(Context Memory Storage,CMX)。上周在美國猶他州鹽湖城舉辦的首屆 VAST Forward 大會上,英偉達與 VAST Data 的代表演示了 CMX 如何突破 GPU 內存墻。

KV 緩存是現代 AI 技術棧的固有組件。有了 KV 緩存,用戶不必每天早上 7 點重新加載所有輸入給 AI 模型的上下文,而是可以將上下文長期保留(按天、按月),以簡單的鍵值存儲形式存放在 HBM、片上內存,最終延伸到存儲介質中。作為 AI 技術棧面向用戶的核心組件之一,KV 緩存自然會受到人類使用需求的影響。換句話說,當員工使用 AI 時 —— 無論是生成貓咪視頻,還是搜索新的核苷酸序列 —— 緩存都會快速占滿。

圖1 不斷膨脹的 KV 緩存正在擠占內存 來源:英偉達與 VAST 在 2026 VAST Forward 大會上的演講《突破 GPU 內存墻》

“KV 緩存的一個核心問題是,它會隨著你使用的上下文長度與批次大小同步增長。” 英偉達高級研究科學家 Vikram Sharma Mailthody 在上周 VAST Forward 的一場演講中表示,“假設我們使用相同的模型進行推理……緩存計算成本會隨上下文長度呈二次方增長。正如你所見,當你需要使用更長的上下文窗口時,系統負擔會顯著增加,這在智能體工作流中尤為明顯。”

這已成為當前擴展 AI 推理系統的核心瓶頸之一。除了 HBM 與 GPU 之間的數據搬運速度之外,HBM 能存儲的數據量,也直接決定了 AI 能完成多少有效工作。當 HBM 占滿后,KV 緩存會開始溢出到系統內存;系統內存也占滿后,就會溢出到本地存儲。但到那時,延遲就會嚴重影響用戶體驗。誰愿意等上五分鐘,才等到智能體 AI 系統給出回答?

“核心結論很簡單:推理上下文離 GPU 越遠,推理的成本就越高、效率也越低。”Mailthody 說,“這就是為什么現有的內存與存儲層級結構,并不適合為下一代 AI 做擴展。也正因如此,我們必須重新構想:存儲應該如何構建,以及應該如何為推理上下文管理而構建。”

英偉達針對 “上下文窗口–GPU 內存墻” 問題的短期解決方案就是 CMX 平臺。該平臺于今年 1 月隨 BlueField?4 DPU(數據處理器)一同發布。英偉達正與包括 VAST Data 在內的存儲合作伙伴合作,大幅擴展 KV 緩存容量,讓客戶能夠用智能體 AI 完成更多工作。

圖2 CMX 旨在擴展客戶 KV 緩存且不損失性能 (來源:同上)

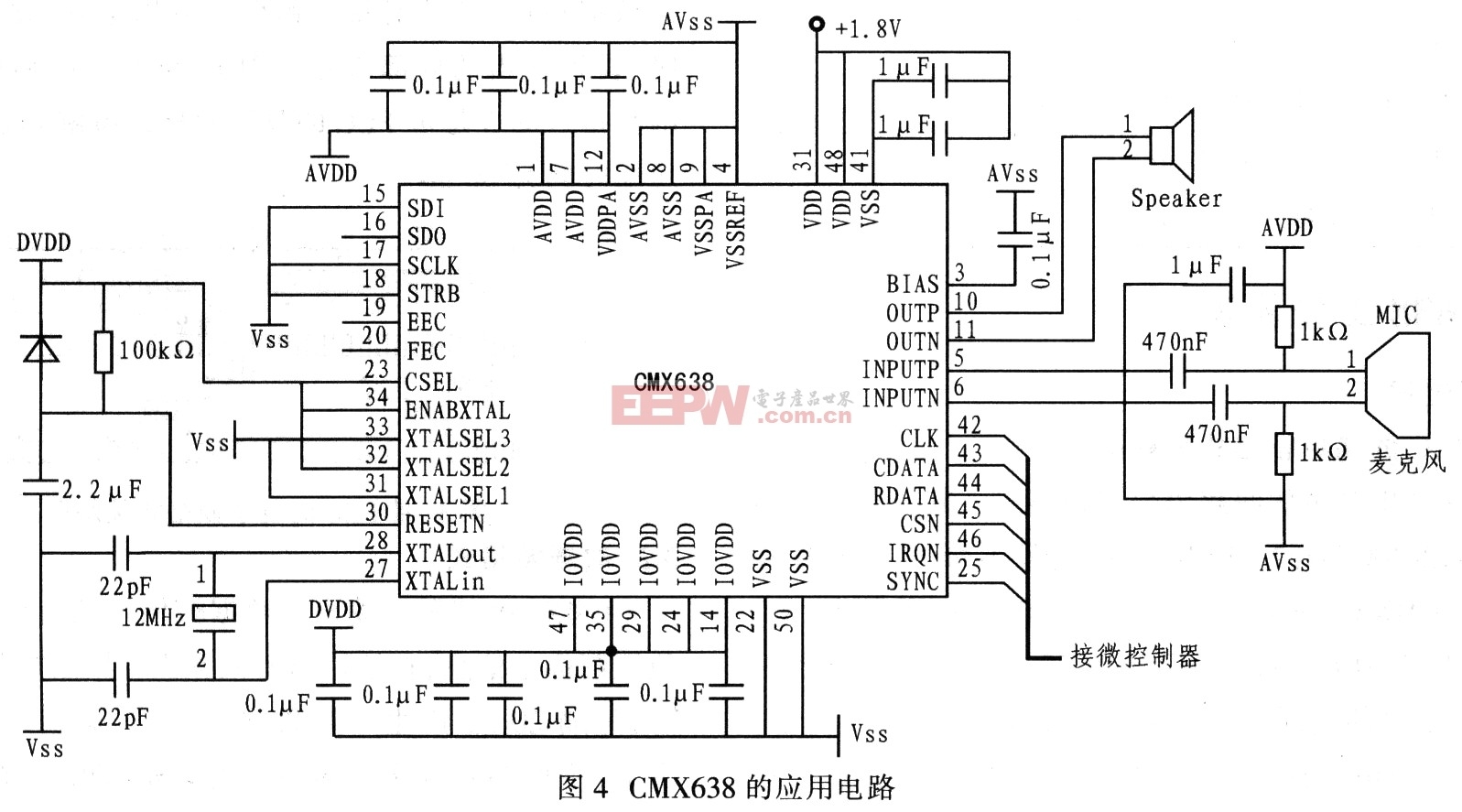

CMX 包含多個組件:

在基礎設施層面,它將使用英偉達下一代 Rubin GPU 系統,并利用部署在 VAST 等存儲廠商管理的存儲集群中的 BlueField?4 DPU。BlueField?4 將幫助管理元數據、減少數據遷移,并讓 Rubin GPU 從數據管理負擔中解放出來。

它還將利用 Spectrum?X 以太網交換機,構建基于 RoCE(面向融合以太網的遠程直接內存訪問) 的高速網絡架構,用于高速共享 KV 緩存數據。

在軟件層面,CMX 將使用英偉達面向 BlueField?4 的 DOCA 開發套件,以及 Nvidia Inference Transfer Library(NIXL)—— 這是一個開源庫,用于加速 Dynamo 內部的數據遷移。Dynamo 是英偉達開源的 AI 推理框架。

Mailthody 表示,CMX + VAST 存儲的組合將提供下一代千兆級推理架構,可實現:

首詞延遲(TTFT)最高提升 20 倍

GPU 利用率提升 90%

存儲功耗降低 70%

VAST AI 架構總監 Anat Heilper 在 VAST Forward 演講中表示,基于 CMX 的鍵值塊管理器,VAST 可以 “從根本上改變計算邏輯”。

“我們把緩慢、重 I/O 的過程,變成了高吞吐量、受網絡限制的過程。” 她說,“本質上,這意味著存儲可以隨網絡一起擴展,以支撐這類工作負載。”

在基于 Llama 3 模型的基準測試中,VAST 實現了 200GbE 網絡接近線速利用率,該網絡連接了 8 張 H100 GPU。

圖3 VAST 與英偉達合作開發 CMX (來源:同上)

“結果顯示,從 VAST 系統中讀取 KV 緩存,相比讓 GPU 重新計算,首詞響應速度提升 20 倍。”Heilper 說,“這是用戶能直觀感受到的變化。原本需要等待 GPU 計算 65 秒,現在只需要 3 秒就能讀取。這是根本性的改變。這種加速,再加上 GPU 時間節省 90%,體現了效率的巨大提升。”

如果使用更快的網絡,收益還會更高,因為 VAST 已經(幾乎)打滿了 200GbE 帶寬。在實際場景中,VAST 估算:通過 CMX 和 BlueField?4 DPU 將 KV 緩存溢出到 VAST NVMe 存儲,利潤可提升 60%~130%。

(VAST 上周還發布了全新 CNode?X,將英偉達 GPU、BlueField?4 DPU 和 Spectrum?X 硅光交換機直接集成到 VAST 存儲集群中。)

“我們假設企業 AI 工作流的緩存命中率保守在 40%~60%。對于智能體工作流和認知任務,提升幅度可能更高。”Heilper 說,“原理很明確:我們沒有讓 GPU 變快 —— 那是英偉達的工作。但我們讓它更常處于可用狀態,并把存儲變成算力倍增器。”

VAST 還給出了一份用于智能體系統的 最佳 KV 緩存容量配置指南:

對于 10,000 名用戶、每輪對話 32GB KV 緩存的組織,要支持 “即時恢復” 會話,需要 320TB 系統。

保留每位用戶最近 5 輪會話(每日備份):需要 1.6PB 系統。

保留最近 15 輪會話(適合程序員、研究員等高頻用戶做周級緩存):需要 4.8PB 系統。

要實現 “智能體記憶”,即 10,000 名用戶每人 150 輪會話:需要 48PB 存儲。

“CMX 是一種專為 KV 緩存設計的新型存儲。”Mailthody 說,“它會取代這里所有的存儲嗎?適合所有人、所有集群嗎?不,并不是。CMX 專為推理和 KV 緩存管理而設計。

如果你的工作負載模型大、需要大緩存,CMX 就是為此而生。

如果你有需要超長輸入序列的場景,比如 AI、聊天機器人或推理模型,它能提供超大內存容量,讓服務極高效。如果你的訪問模式存在大量內容復用,或是擁有跨多洲共享的大型 GPU 集群,CMX 能輕松啟用并提升運營效率。”

評論